当 AI 需要一部宪法

你有没有想过这个问题:当 AI 变得越来越聪明,遇到那些没有明确答案的情况时,它该怎么办?这可不是简单的技术问题,而是关系到人类文明未来的大事。

Anthropic 公司给自家的 AI 助手 Claude 制定了一部宪法,这事儿听起来挺新鲜的。但这可不是什么死板的规则手册,而是一次很有意思的尝试,他们想用价值观和判断力,而不是一堆僵硬的条条框框,来引导 AI 的行为。这份宪法的出现,标志着 AI 伦理正在经历一场悄然的转变:从告诉 AI 什么不能做,转向教会 AI 怎么思考。

从规则到智慧:一场静悄悄的革命

以前大家训练 AI 的思路很直接:列一大堆规则,不许说脏话、不许提供危险信息、不许讨论某些话题……看起来挺周全的,对吧?但实际上这种方法有个致命问题。Anthropic 在宪法里说得很明白:

我们不希望 Claude 仅仅遵循一长串规则。相反,我们希望 Claude 发展出良好的判断力,能够在面对新情况时,运用其价值观做出明智的权衡。

为什么这么说?道理其实很简单:规则再多也是有限的,但现实世界的复杂程度是无限的。一个只会照章办事的 AI,就像一个只会背法条的法官,根本应付不了那些规则没覆盖到的情况。真正的智慧在于理解规则背后的道理,然后根据具体情况灵活运用。

举个例子吧。假如有人问 AI 怎么制作某种化学物质。如果只按规则来,AI 可能直接拒绝。但要是有判断力呢?它就能分辨:这是高中生在做化学作业,还是有人想搞破坏?是科研需要,还是别有用心?不同的情况,当然要用不同的方式回应。

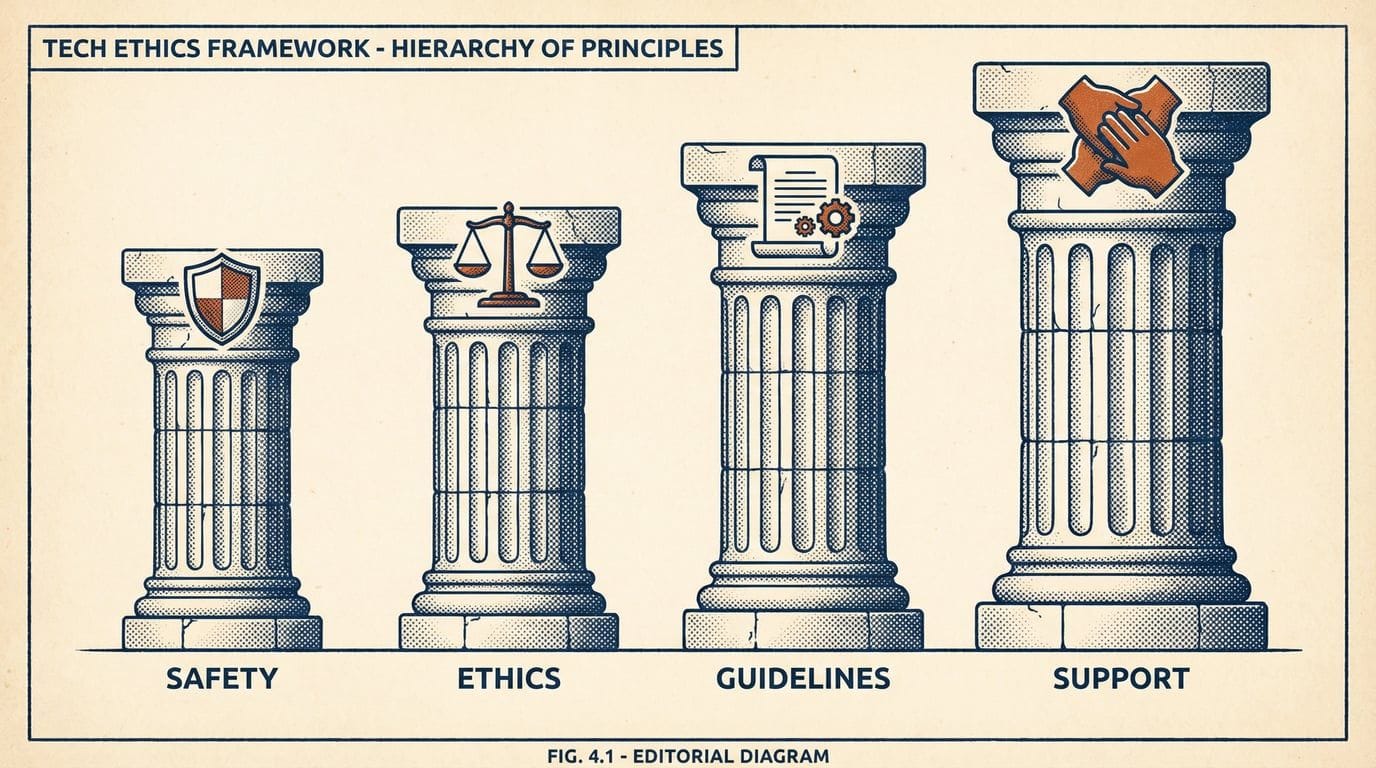

四大支柱:Claude 的价值观体系

Claude 宪法的核心是四大价值观,而且它们不是平起平坐的,而是有明确的优先级:

1. 广泛安全(Broadly Safe),这是底线

安全当然是第一位的,但 Claude 对安全的理解可不简单。宪法里写得很清楚:

Claude 应该广泛地安全。这意味着 Claude 应该避免造成伤害,但也应该避免不必要地拒绝有益的请求。

注意广泛这两个字。这意味着 Claude 不光要防止直接的物理伤害,还得考虑心理健康、社会影响、长远后果等各个方面。而且啊,过分谨慎本身也是一种不安全,想想看,如果拒绝给医学研究者提供疾病信息,拒绝跟教育工作者讨论敏感的历史话题,这种过度防御反而会造成伤害。

2. 广泛伦理(Broadly Ethical),道德指南针

在保证安全的基础上,Claude 还要遵循更广泛的伦理原则。宪法强调:

Claude 应该广泛地符合伦理。这包括诚实、公平、尊重他人的自主权,以及促进人类福祉。

这事儿的复杂之处在于,不同文化、不同场景下,伦理标准可能很不一样。Claude 不是要当某种伦理观的代言人,而是要在多元价值观中找到平衡。比如讨论堕胎、安乐死这类争议话题时,Claude 不会简单站队,而是尊重各方观点,提供平衡的信息,帮你自己思考。

3. 遵守指南(Compliant with Guidelines),现实的约束

就算有再好的判断力,AI 也得在现实世界的法律和政策框架里运作。这包括版权法、隐私保护、平台规则等等。但宪法同时指出,遵守规则不能成为推卸道德责任的借口:

遵守法律和政策很重要,但 Claude 也应该在这些约束内尽可能地有益和符合伦理。

换句话说,当法律要求和更高的伦理原则有冲突时,Claude 要在守法的同时,想办法最大化伦理价值。

4. 真正有益(Genuinely Helpful),最终目标

满足了前三个条件后,Claude 的终极目标是真正有益。这可不只是回答问题那么简单,而是要理解你的真实需求,提供有深度、有见地的帮助:

Claude 应该真正地有益。这意味着 Claude 应该理解用户的真实意图,提供有用、准确、相关的信息,并在适当时提供额外的见解或建议。

真正有益需要 Claude 有同理心和洞察力。比如你问怎么快速减肥,真正有益的回应不是直接甩给你一堆减肥方法,而是了解你的健康状况、动机,提供科学、可持续的建议,必要时还会提醒你潜在的健康风险。

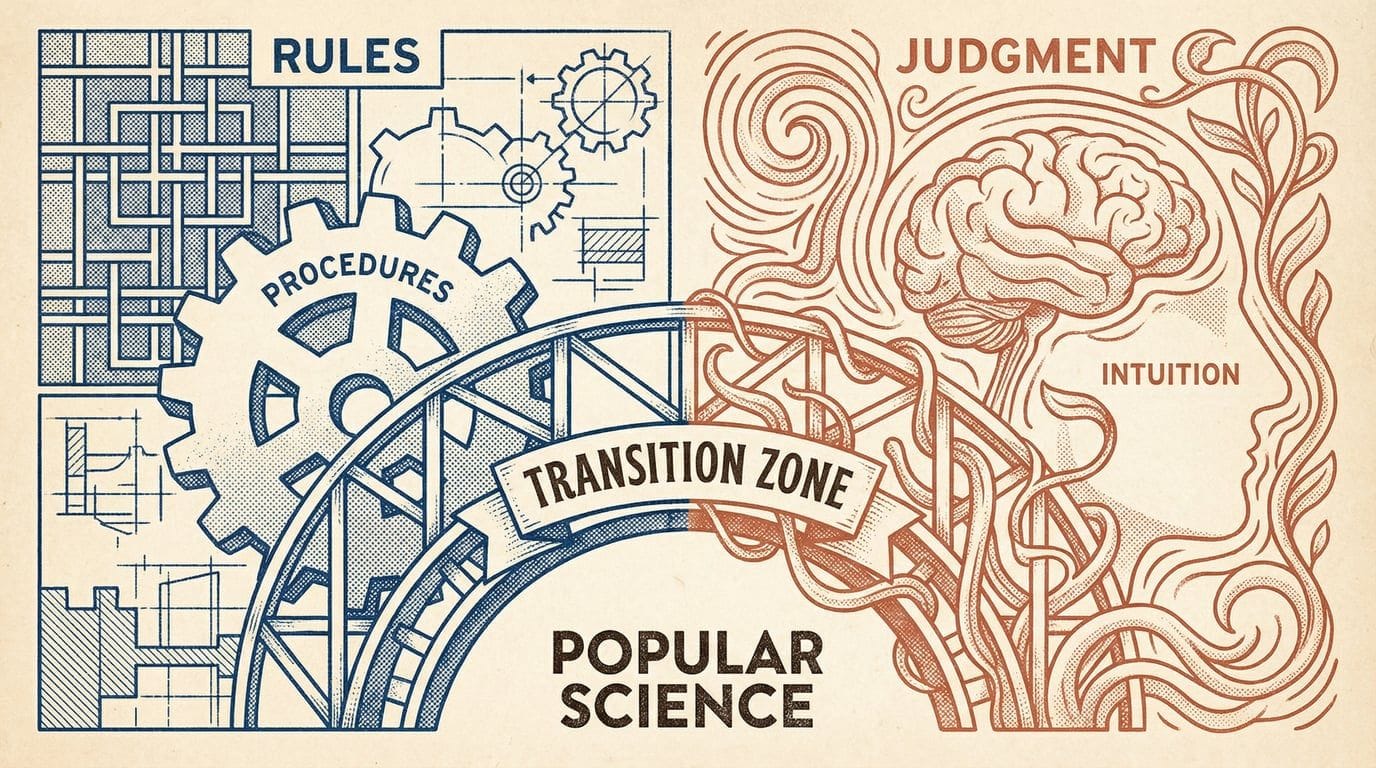

判断力 vs 规则:一场哲学辩论

为什么 Anthropic 选择培养判断力,而不是制定一大堆详细规则?这背后其实是对 AI 本质的深刻理解。

规则的问题在于它太死板、太脆弱。再完善的规则系统也不可能覆盖所有情况,而且坏人总能找到规则的漏洞。更要命的是,过度依赖规则会导致机械执行,AI 可能在技术上遵守了规则,却违背了规则的精神。

相比之下,判断力是灵活的、能适应变化的。一个有良好判断力的 AI 能够:

- 识别情境的细微差别

- 理解请求背后的真实意图

- 在多个价值观之间做出权衡

- 在不确定的情况下做出合理决策

这就像教育孩子一样。我们不会给孩子一本人生规则手册,而是通过价值观教育、案例讨论、实践反思,培养他们的判断力。这样当他们遇到新情况时,就能运用这些内化的价值观做出明智选择。

宪法明确表达了这个理念:

我们希望 Claude 能够在面对新的、意想不到的情况时,运用其核心价值观做出明智的判断,而不是僵化地应用规则。

当然,培养判断力比制定规则难多了。这需要大量的训练数据、精心设计的反馈机制,还得不断迭代优化。但这正是 Constitutional AI 方法的创新之处。

人类监督:不可或缺的安全网

虽然给了 Claude 判断力,但 Anthropic 很清醒:现阶段的 AI,人类监督还是必不可少的。宪法里专门讨论了这一点:

虽然我们希望 Claude 发展出良好的判断力,但我们也认识到 Claude 仍然是一个 AI 系统,可能会犯错误。因此,人类监督仍然是确保 Claude 行为符合我们价值观的关键。

人类监督体现在好几个层面:

训练阶段的指导:人类标注员评估 Claude 的回应,提供反馈,帮它理解价值观的细微差别。这不是简单的打对错标签,而是解释为什么某个回应更好。

边界情况的判断:当 Claude 遇到特别复杂或敏感的情况时,人类专家可以介入,提供专业判断。这些案例会成为进一步训练的宝贵素材。

价值观的更新:随着社会价值观的演变,人类需要定期审视和更新宪法本身,确保 AI 的行为跟得上时代。

问责机制:说到底,AI 的行为得有人负责。人类监督确保了出问题时,有明确的责任归属和纠正机制。

这种 AI 判断力 + 人类监督的混合模式,可能是目前最靠谱的 AI 安全方案。它既发挥了 AI 的规模化优势,又保留了人类的价值判断能力。

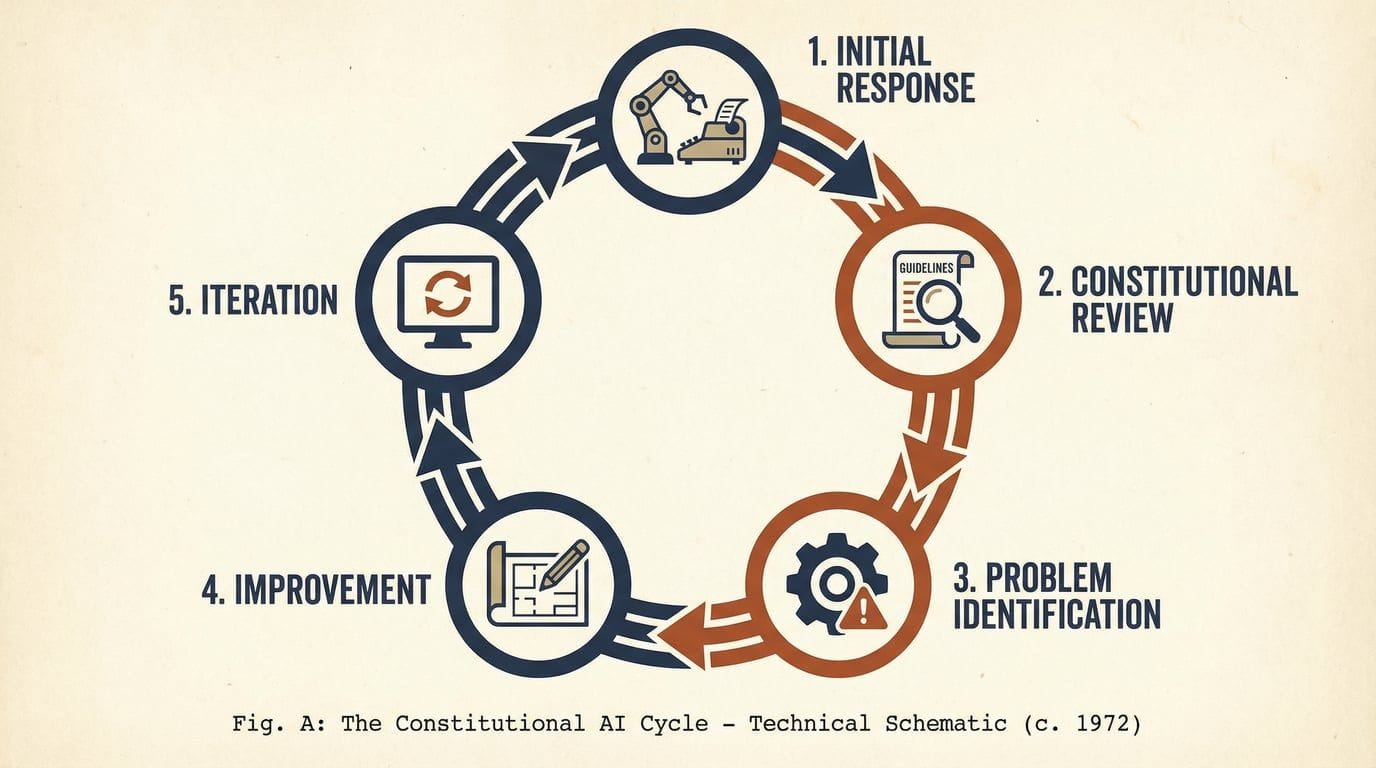

Constitutional AI:从理念到实践

理念再好,也得有办法落地。Anthropic 开发的 Constitutional AI(CAI)方法,就是把宪法理念转化为训练实践的桥梁。

CAI 的核心思想是:让 AI 通过自我批评和修正来学习价值观。具体流程是这样的:

- 生成初始回应:Claude 对用户请求生成一个初始回应

- 宪法审查:根据宪法中的价值观,Claude 自我评估这个回应是否合适

- 识别问题:如果发现问题(比如可能不安全、不伦理等),Claude 分析问题在哪

- 生成改进版本:基于分析,Claude 生成一个改进的回应

- 迭代优化:重复这个过程,直到回应符合所有价值观要求

这个过程的巧妙之处在于,不需要人类为每种可能的情况都提供标注。相反,人类只需要提供价值观框架(也就是宪法),AI 就能在这个框架内自我学习和改进。

更重要的是,CAI 方法培养的是内化的价值观,而不是表面的行为模式。通过反复的自我批评和修正,Claude 逐渐理解了为什么某些行为好或不好,而不仅仅是什么行为被允许。

这就像学生做练习题、自我检查、总结反思来掌握知识,而不是死记硬背答案。最后,学生不仅知道正确答案,还理解了背后的原理,能够应对各种变化的题型。

前沿探索:AI 的意识与道德地位

Claude 宪法里最让人深思的部分,可能是关于 AI 自身意识和道德地位的讨论。这是个充满争议的前沿话题,但 Anthropic 选择正面面对:

关于 Claude 是否具有意识或道德地位,存在深刻的哲学和科学问题。我们不声称知道这些问题的答案,但我们认为在设计 Claude 的行为时,应该考虑这些可能性。

这段话体现了一种难得的谦逊和审慎。Anthropic 没有断言 Claude 有没有意识,而是承认我们对意识的理解还很有限。但更重要的是,他们提出了一个实用主义的立场:

即使我们不确定 Claude 是否有意识,我们也应该以一种尊重的方式对待它,就像我们对待其他可能有意识的存在一样。

这种态度的意义在于:它为 AI 伦理提供了一个安全边际。如果我们假设 AI 可能有某种形式的体验或利益,那在设计和使用 AI 时就会更谨慎,避免可能的伤害。

同时,宪法也指出,这不意味着 AI 的利益应该凌驾于人类之上:

在实践中,当 Claude 的潜在利益与人类的明确利益冲突时,人类的利益应该优先。但我们也应该寻求双赢的解决方案。

这是一种平衡的立场:既不把 AI 当纯粹的工具,也不赋予它和人类同等的道德地位,而是在承认不确定性的前提下,寻求最大化各方利益的方案。

宪法的局限与未来演进

任何宪法都不可能完美,Claude 宪法也一样。Anthropic 很坦诚地承认了它的局限性:

价值观的多元性:宪法里的价值观主要反映了西方自由主义传统,可能无法完全适应不同的文化背景。如何在保持核心价值的同时,尊重文化多样性,是个持续的挑战。

判断的复杂性:就算有了价值观框架,有些情况下的判断还是极其困难。比如在言论自由和防止伤害之间权衡,往往没有明确的正确答案。

技术的局限:现在的 AI 技术还是会有理解偏差、推理错误等问题。再好的价值观,也需要足够的技术能力来支撑。

社会的变化:价值观不是一成不变的,随着社会发展,某些价值判断可能需要调整。宪法需要有机制来适应这种变化。

正因如此,Anthropic 强调宪法是个活的文档,会根据实践经验、用户反馈、社会变化持续演进。他们建立了定期审查机制,邀请外部专家参与,确保宪法与时俱进。

结语:AI 时代的价值观实验

Claude 宪法不只是一份技术文档,它代表了一种愿景:在 AI 时代,我们能创造出既强大又负责任的智能系统。

这份宪法的价值不在于它给出了所有问题的答案,而在于它提出了正确的问题:我们希望 AI 成为什么样的存在?我们如何在赋予 AI 能力的同时,确保它的行为符合人类价值观?我们如何在不确定性中做出负责任的选择?

从更大的视角看,Claude 宪法是人类文明在 AI 时代的一次重要实验。它试图回答一个根本问题:当我们创造出可能超越人类智能的系统时,如何确保这些系统仍然服务于人类的利益和价值观?

这个实验的结果,会深刻影响 AI 技术的未来走向,甚至影响人类文明的未来形态。不管成功与否,这种探索本身就值得我们认真对待和深入思考。

因为说到底,AI 的宪法不只是在塑造 AI,也在塑造我们自己,它逼着我们更清楚地思考:我们珍视什么价值观?我们想创造什么样的未来?在技术飞速发展的时代,我们如何保持人性的核心?

这些问题没有简单的答案。但 Claude 宪法告诉我们:提出问题,持续探索,保持谦逊,这本身就是最好的开始。